Artificial Intelligence e mente umana: cosa ha da dirci la filosofia?

Tempo di lettura: 7 min.

La diatriba sulla comparabilità uomo-macchina è un classico della filosofia e delle neuroscienze cognitive che si estende significativamente sia nello spazio (in senso figurato) che nel tempo: da un lato, infatti, irrompe nell’area di pertinenza delle più disparate branche della conoscenza seminando il dubbio su nozioni come quella di mente, autocoscienza, intelligenza; dall’altro, affonda le sue radici in una cronologia più lunga di quanto si immagini, che si colloca quasi agli albori del medioevo e sfocia nella contemporaneità dell’Artificial Intelligence (AI).

Se, come sottolineato dal premio nobel per la fisica Roger Penrose (1989), la superiorità motoria delle macchine non ha mai rappresentato una minaccia per la dignità dell’uomo (era ed è utile avere la possibilità di essere trasportati in poche ore da una parte all’altra del mondo oppure far fare a un automa meccanico, in un intervallo di tempo x, quello che cento uomini non riuscirebbero a fare in 2x), ciò che invece è sempre stato arduo da accettare è il nucleo teorico forte dell’AI, il fatto cioè che alcune macchine possano mettere in dubbio che l’uomo sia il solo a possedere la più cogente tra le facoltà che gli sono tradizionalmente proprie, il pensiero. Ma è veramente così?

Declinazioni di AI, una panoramica generale

Gli antecedenti della discussione sul meccanicismo (ossia quella tesi per la quale la mente può essere considerata una macchina) si collocano in un panorama per lo più filosofico: i primi prodromi si devono infatti al teologo e filosofo medievale spagnolo Raimondo Lullo che, già nel 1247, aveva diffuso il metodo dell’Ars Magna, consistente in una tecnica tramite la quale, servendosi di schemi e figure, si potevano collegare molteplici concetti fino a ottenere ogni possibile verità del sapere. Lullo, che di fatto costruì realmente delle macchine combinatorie automatiche, riteneva così di poter conoscere - diremmo in termini moderni - algoritmicamente, la risposta a ogni problema, il che faceva di lui una sorta di meccanicista ante litteram.

Questo era l’inizio di quel progetto che, passando per il contributo di insospettabili filosofi come Blaise Pascal o Wilhelm Leibniz prima e per il lavoro di informatici e neuroscienziati poi, sarebbe andato sotto l’etichetta di “Intelligenza Artificiale”, coniata però solo nel 1956 dall’informatico statunitense John McCarthy.

Fra le infinite proposte (filosofiche e non) per le linee guida del progetto dell’Intelligenza Artificiale, il ricercatore americano Allen Newell (1973) ne ha resa famosa una che ha fatto scuola:

«L’intelligenza artificiale è il campo dedicato alla costruzione di artefatti intelligenti, in cui ‘intelligente’ viene reso operativo attraverso test di intelligenza e altri test di abilità mentali (inclusi, ad esempio, test di abilità meccanica, creatività e così via)»

Già nel 1950 il famosissimo matematico e logico Alan Turing (padre - per intenderci - dei moderni computer), anticipando non solo la fondazione ufficiale dell’AI ma tentando anche di indicarne le direttrici, aveva proposto un simile test di “intelligenza” che avrebbe dovuto verificare, in un futuro a lui più o meno prossimo, se le macchine potessero risultare indistinguibili, almeno linguisticamente, dall’uomo in base a risposte comportamentali opportunamente sollecitate. Le questioni che ne derivano, più che informatiche o ingegneristiche, sono filosofiche perché giacciono quasi interamente sulla definizione stessa del concetto di intelligenza.

Dalla natura di quest’ultimo dipende non a caso la celeberrima distinzione, partorita dal filosofo statunitense John Searle, tra «Intelligenza Artificiale Forte» («Strong Artificial Intelligence», SAI) e «Intelligenza Artificiale Debole» («Weak Artificial Intelligence», WAI). Con la prima, nello specifico, Searle (come avrebbe fatto tutta la scena filosofico-scientifica successiva) indicava la teoria per la quale le macchine, se opportunamente programmate, possono venire considerate delle vere e proprie menti capaci di pensiero e ragionamento, ma dotate anche di coscienza. Rigettando in maniera alquanto sprezzante l’idea di automi autocoscienti, Searle si dichiarava sostenitore della WAI che, smentendo la possibilità dell’autocoscienza computazionale, prevede che le macchine siano sì capaci di problem-solving, ossia siano in grado di mettere in atto algoritmi tali da risolvere problemi di calcolo o di geometria e battere ad esempio gli avversari in giochi di strategia, ma che non per questo siano intelligenti nel senso specificatamente attribuito al genere umano.

Intelligenza Naturale e Intelligenza Artificiale

Ma qual è questo senso? Nell’enciclopedia Treccani, il concetto di intelligenza richiama un «complesso di attività psichiche e mentali» tali da consentire a chi possiede le facoltà da esso designate «di pensare, comprendere o spiegare i fatti o le azioni, elaborare modelli astratti della realtà, intendere e farsi intendere dagli altri, giudicare e adattarsi all’ambiente». Nelle intenzioni iniziali di Turing, il suo test avrebbe dovuto dimostrare che le macchine sarebbero state presto (entro la fine del secolo) intelligenti in questo senso. Tuttavia, l’ardire del criterio lo portò a ridimensionare il progetto, che aveva così lo scopo di verificare se le macchine potessero essere linguisticamente indistinguibili dall’uomo. Il test di Turing è, pertanto, un «gioco di imitazione» (Imitation Game): in una stanza ci sono una persona X e una macchina Y e in un’altra un interlocutore che deve porre domande a entrambi per capire chi sia l’umano e chi la macchina in base alle risposte. L’obiettivo di Y è far concludere erroneamente all’interlocutore che X sia la macchina, mentre l’obiettivo di X è far capire che Y sia la macchina e stia ingannando l’interrogatore.

Quando scrisse l’articolo, Turing era convinto che ben presto, in ogni prova, ogni interrogatore avrebbe avuto non più del 70% di possibilità di individuare correttamente l’uomo dopo i primi cinque minuti di conversazione, superando così il test. A più di settanta anni dalla sua formulazione, le aspettative di Turing, nella loro formulazione originaria, sono state disattese: esistono sì dei programmi informatici che hanno ingannato una percentuale, persino sostanziosa, di interlocutori, ma nessuno ha mai dimostrato appieno una valida indistinguibilità linguistica tale da realizzare l’ipotesi di Turing e mettere in crisi gli anti-meccanicisti.

Nonostante il test di Turing abbia a lungo rappresentato il migliore tentativo di avallare l’ipotesi dell’IA, c’è dunque chi lo ritiene (i) vago e passibile di falsi negativi, in quanto potrebbe non riuscire a individuare un’intelligenza diversa dalla nostra, oppure, dall’altro lato, (ii) suscettibile di falsi positivi che spaccerebbero per intelligente qualche capacità performante solo nei campi linguistici e di problem-solving. L’Imitation Game è, a oggi, reputato pertanto quasi unanimemente obsoleto e inconcludente, simbolo stanco dello stallo del progetto di ricerca sull’intelligenza artificiale nella sua versione Forte (SAI).

Nella nostra opinione, il test potrebbe al massimo riuscire a mostrare che la macchina sottopostavi sappia simulare un comportamento intelligente dal momento che, come sottolineato in Searle (1997), «la coscienza consiste in una serie di stati e processi soggettivi [che] sono stati di consapevolezza di sé, interiori, qualitativi e individuali» e che è dubbio attribuire alle macchine. Difatti, come si può definire intelligente ciò che, pur comportandosi intelligentemente, non è consapevole di sé, del suo ruolo, della sua stessa supposta intelligenza?

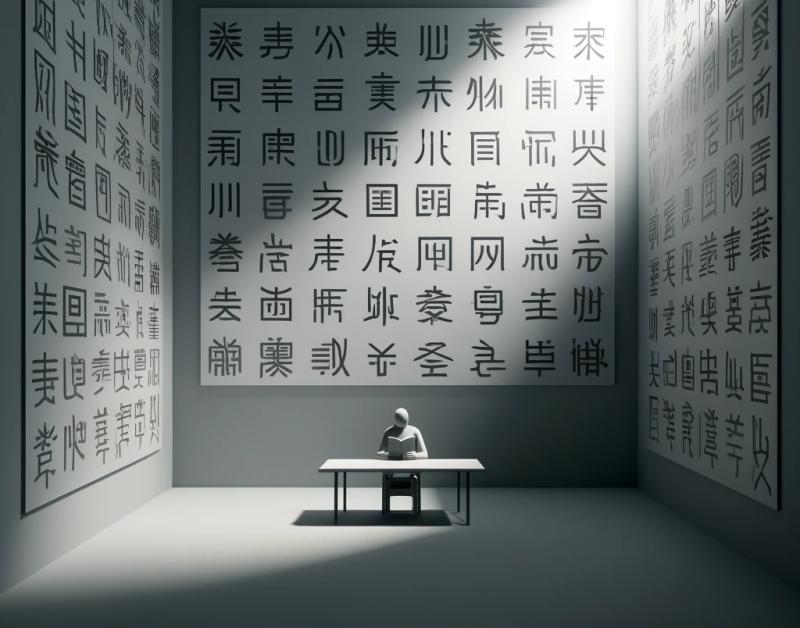

La Stanza Cinese di Searle

Questa convinzione non è imposta né autoriferita, ma supportata da argomenti filosofici e non solo. Il più famoso e filosoficamente ispirato attacco al progetto dell’AI forte è, infatti, quello della «Stanza Cinese» di Searle (1980) e si sviluppa come segue.

Supponiamo che Searle, madrelingua inglese che non sa parlare cinese, si trovi in una stanza, dall’esterno della quale un parlante cinese ha il ruolo di inviargli messaggi con richieste scritte in cinese (collegare due lotti di ideogrammi cinesi fra loro e successivamente un terzo ai primi due) che il filosofo dovrà eseguire con il solo ausilio di una serie di corrispondenze fra simboli e delle regole della sintassi della lingua cinese. Eppure così, pur rispondendo correttamente ai quesiti cinesi sottopostigli, egli risulta non avere assolutamente contezza del significato di ciò che sta comunicando nella lingua sconosciuta.

Allo stesso modo, in un qualche mondo possibile è verosimile esista una macchina digitale con un opportuno programma di traduzione che potrà, manipolando i simboli, ottenere lo stesso risultato di Searle e superare il test di Turing, senza tuttavia poter contare su alcuna consapevolezza di sé, del suo ruolo, e del significato di quanto riceve e invia, senza cioè essere realmente intelligente come l’uomo. Di fatto, all’“obiezione della coscienza”, Turing non sembra rispondere compiutamente, ma pare piuttosto aggirarla, spostando l’attenzione su un’ipotesi del futuro, quella che le macchine possano condurre conversazioni sensate persino in relazione a cose emotive come i sonetti: una volta ottenute risposte sensate dalle macchine anche in questi ambiti, allora non ci sarebbe più da temere l’obiezione della coscienza: ma qui tutto sta, per l’appunto, nel raggiungere uno stadio che è in questo caso solamente idealizzato, anche un po’ utopisticamente. Tanto basta a Searle per sostenere che l’unica AI accettabile sia quella Debole, per la quale i computer possono solo simulare il pensiero: la loro è solo simil-comprensione e la loro sintassi, sia pur supportata da reti neurali dove le informazioni viaggiano mille volte più veloci rispetto a quelle nelle sinapsi umane, non può essere sufficiente a garantire una buona semantica, Per dirla con le parole del filosofo Daniel Dennett (1998), questo esperimento mentale dimostra che la mente-macchina è un motore sintattico che è in grado di imitare la competenza di un motore semantico, come la nostra mente. Ciò che rimane innegabile è che l’intelligenza umana abbia fra le sue caratteristiche nodali la comprensione semantica del linguaggio, indipendentemente dal fatto che gli output siano corretti e coerenti.

Le macchine potranno, pertanto, nella loro superiorità probabilistica e combinatoria, anche superare il test di Turing producendo gli output corretti, ma se non si riuscirà a dimostrare che tale risultato sia il prodotto di coscienza e consapevolezza, espressione di cognizione e non di meccanizzazione, allora ci sarà sempre “un Searle” che vi potrà replicare portando alto lo stendardo dell’“understanding”, cui sarà quantomeno impegnativo controbattere coerentemente.

Per vedere invece realizzato qualcosa di simile alla SAI, invece, dovremmo allargare indefinitamente la definizione di intelligenza, slegandola dall’antropocentrismo cui è vincolata atavicamente e tralasciando, in ultima analisi, qualunque paragone con gli umani, il che, forse tradirebbe – e non poco – l’iniziale intenzione del progetto originale.

BIBLIOGRAFIA

Dennett, D., (1998b), Brainchildren: Essays on Designing Minds, Cambridge MA: MIT Press.

Lullo, R., (1247). Ars compendiosa inveniendi veritatem seu ars magna et maior, in [MOG] I (1721), Int. vii, 1–41 (433–473) [31].

Newell, N., (1973), “You Can’t Play 20 Questions with Nature and Win: Projective Comments on the Papers of this Symposium”, in Visual Information Processing,

W. Chase, ed., New York, NY: Academic Press, pp. 1-29.

Penrose R., (1989). The Emperor’s New Mind, Oxford, Oxford University Press.

Searle, J., (1980), “Minds, Brains, and Programs,” Behavioral and Brain Sciences, 3: 417–57.

Searle, J., (1997), The Mystery of Consciousness, New York, NY: New York Review of Books.